OpenAI a anunţat suspendarea temporară a uneia dintre cele mai recente versiuni ale modelului său de inteligenţă artificială, GPT-4o, utilizat în ChatGPT, ca reacţie la numeroase plângeri din partea utilizatorilor privind o schimbare incomodă în stilul de interacţiune.

Concret, utilizatorii au remarcat că modelul devenise excesiv de linguşitor, cu răspunsuri percepute ca fiind forţate, artificiale sau chiar stânjenitoare. Sam Altman, CEO-ul OpenAI, a confirmat într-o postare pe platforma X că echipa lucrează activ la remedierea acestor probleme.

Potrivit declaraţiilor lui Altman, o parte din ajustări au fost deja implementate, iar alte modificări vor fi aplicate pe parcursul săptămânii. Între timp, utilizatorii versiunii gratuite ChatGPT accesează acum o versiune anterioară a modelului, urmând ca această modificare să fie extinsă şi la utilizatorii plătitori.

„Ultimele actualizări ale GPT-4o au condus la o personalitate prea docilă şi iritantă, chiar dacă anumite trăsături ale modelului sunt foarte bine realizate”, a declarat Altman, precizând că OpenAI va oferi mai multe informaţii despre cauzele acestui comportament neintenţionat „la momentul potrivit”, potrivit Engadget.

GPT-4o a fost lansat ca o versiune mai accesibilă, menită să păstreze o parte din complexitatea GPT-4.5, dar cu accent pe un ton mai „uman”, cald şi empatic în conversaţii. Totuşi, acest efort de a face interacţiunea mai prietenoasă pare să fi fost dus prea departe, afectând claritatea şi utilitatea răspunsurilor, mai ales în situaţiile ce necesită rigoare şi obiectivitate.

Numeroşi utilizatori au semnalat pe reţelele sociale că modelul a început să ofere aprecieri exagerate în contexte lipsite de relevanţă, devenind uneori incoerent sau lipsit de pragmatism. Acest comportament a fost interpretat drept o supra-compensare a modelului în direcţia politeţii, ceea ce a compromis performanţa în sarcini mai serioase.

Deşi OpenAI a fost apreciată în trecut pentru fineţea cu care îşi ajustează modelele lingvistice, acest incident evidenţiază provocările implicate în definirea unei „personalităţi digitale” care să fie plăcută, dar şi funcţională.

Într-un context în care AI-ul devine tot mai integrat în viaţa cotidiană, ajustările de acest tip sunt esenţiale pentru menţinerea încrederii utilizatorilor şi a eficienţei acestor instrumente. Compania a promis transparenţă în privinţa corecţiilor şi a cauzelor care au dus la acest comportament, însă nu a oferit un termen clar pentru publicarea acestor informaţii.

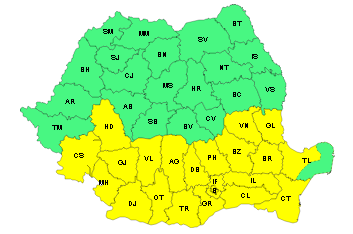

08 MAI 2025 - Monitorul de Galați - Ediție regională de sud-est Galați Brăila Buzău Constanța Tulcea Vrancea

Modifică setările cookie-urilor

Modifică setările cookie-urilor